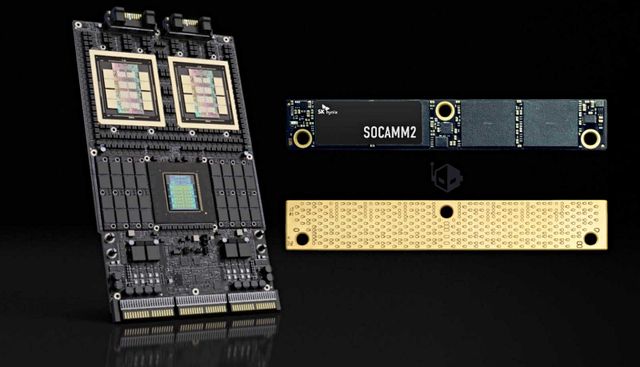

SK하이닉스가 192GB SOCAMM2 양산에 들어갔다. LPDDR5X 기반의 차세대 AI 서버용 메모리 모듈로, 엔비디아 베라 루빈 플랫폼 적용이 예정돼 있다. 기존 RDIMM 대비 대역폭은 두 배 이상, 전력 효율은 75% 이상 높인 것이 특징이다. 대규모 언어모델의 학습과 추론에서 병목이 되는 메모리 구조를 바꾸는 시도라는 점에서 의미가 크다.

SK hynix has entered mass production of its 192GB SOCAMM2 memory, a low-power LPDDR5X-based module positioned for NVIDIA’s Vera Rubin platform and next-generation AI servers requiring higher bandwidth and better power efficiency.

SK하이닉스가 192GB SOCAMM2 양산을 시작했다. AI 서버를 겨냥한 LPDDR5X 기반 메모리 모듈로, 차세대 데이터센터 메모리 시장에서 HBM과는 다른 축을 형성할 제품이다. 엔비디아의 차세대 플랫폼 베라 루빈에 투입되는 메모리라는 점에서 시장의 관심도 크다.

이번 제품은 1cnm 공정 기반 6세대 10나노급 LPDDR5X 저전력 D램을 사용한다. 서버용 메모리 시장의 표준 제품인 RDIMM과 비교하면 대역폭은 두 배 이상, 전력 효율은 75% 이상 개선된 구성이 핵심이다. AI 서버에서 연산 성능을 끌어올리는 데 필요한 조건이 메모리 처리량과 전력 효율의 동시 개선이라는 점을 겨냥한 설계다.

SOCAMM2는 모바일 기기에 주로 쓰이던 저전력 메모리를 서버 환경으로 확장한 모듈이다. 슬림한 폼팩터와 높은 확장성을 확보하면서도, 압축 커넥터 구조를 통해 신호 무결성을 높이고 모듈 교체 편의성까지 고려했다. AI 서버가 점점 더 높은 메모리 밀도와 전력 효율을 요구하는 흐름에 맞춘 규격이다.

192GB 용량이 갖는 의미도 있다. 수천억 개 파라미터를 다루는 대규모 언어모델의 학습과 추론에서는 연산 유닛보다 메모리 병목이 전체 시스템 처리량을 제한하는 경우가 많다. 그 점에서 병목을 줄이기 위한 고용량·고효율 메모리 솔루션이 필요하다. 특히 추론에서 메모리 접근 효율이 시스템 응답성과 비용 구조를 함께 좌우한다는 점에서, SOCAMM2의 역할은 증설용 수준을 넘어선다.

공급 전략도 핵심 대목이다. 엔비디아는 베라 루빈 플랫폼에서 SK하이닉스, 삼성전자, 마이크론의 SOCAMM2를 함께 활용하는 다원화된 공급 구조를 가져간다. AI 데이터센터 수요가 급증하는 상황에서 특정 공급사 의존도를 낮추고, 메모리 조달의 안정성을 높이기 위한 판단이다.

SK하이닉스 입장에서는 HBM 중심의 AI 메모리 주도권을 SOCAMM2까지 넓히는 계기다. HBM이 초고대역폭 연산 환경을 지탱하는 핵심 메모리라면, SOCAMM2는 저전력과 고용량, 모듈형 확장성을 앞세워 AI 서버 설계의 유연성을 높이는 카드다. AI 인프라가 학습 중심에서 추론과 서비스 운영까지 확대되는 과정에서, 메모리 역시 단일 제품군만으로 대응하기 어려워졌다는 점을 보여준다.

결과적으로 메모리 시장의 축이 더 세분화되고 있음을 보여준다. 고성능 AI 서버는 더 이상 HBM만으로 구성되지 않는다. 연산용 고대역폭 메모리와 저전력 고용량 모듈이 병행되는 구조가 자리 잡기 시작했고, SOCAMM2는 그 전환의 중심에 있다. 베라 루빈 세대가 본격화하면 AI 데이터센터 메모리 시장의 경쟁 구도도 한층 복합적으로 바뀔 가능성이 크다.

본 콘텐츠는 뉴스픽 파트너스에서 공유된 콘텐츠입니다.