AI 인프라 기업 야타브가 대규모 언어모델(LLM) 학습 비용을 낮출 수 있는 압축 기술 연구 결과를 공개했다. 추론 단계에서 활용되던 기술을 학습 영역으로 확장한 시도라는 점에서 업계의 관심이 쏠린다.

야타브 리서치랩은 30일, Google Research가 발표한 ‘TurboQuant’ 기술에서 착안해 분산 학습용 알고리즘 ‘TurboQuant-Adam’을 설계하고 초기 검증을 진행했다고 밝혔다. 연구는 김광일 CTO가 주도했으며, 소규모 환경에서 수행된 탐색적 성격의 결과다.

기존 TurboQuant는 AI 모델 추론 과정에서 데이터 통신량을 줄이기 위한 압축 기술로 알려져 있다. 고차원 벡터를 변환해 효율적으로 양자화하는 방식으로, KV 캐시 압축과 벡터 검색 등에서 성능을 입증했다. 다만 학습 단계에 적용하는 연구는 제한적이었다.

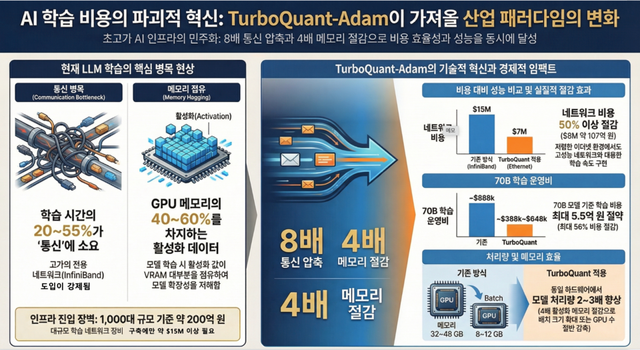

야타브는 해당 개념을 학습 환경에 맞게 변형해 적용했다. 초기 실험에서는 분산 학습 과정에서 노드 간 통신량을 기존 대비 8분의 1 수준으로 줄이면서도 모델 수렴성은 유지되는 결과를 확인했다. 약 3억 5,500만 파라미터 규모 모델에서 손실 값 차이가 0.0023 수준에 그쳤다.

연구 과정에서 기존 이론의 한계도 드러났다. 학계에서 널리 활용되던 오차 보상(Error Feedback) 기법이 AdamW 옵티마이저와 결합될 경우 학습 안정성이 저하되는 현상이 관찰됐다. 또한 일부 경량화 기법은 소형 모델에서는 작동하지만 일정 규모 이상에서는 불안정해지는 경향도 확인됐다.

이에 연구팀은 모멘텀 단계에서 오차를 보정하는 방식과 분산 값을 실시간으로 갱신하는 구조를 적용해 문제를 완화했다. 동시에 월시-아다마르 변환과 4비트 양자화를 결합해 통신 데이터와 메모리 사용량을 줄이는 방식을 설계했다.

실험 결과, 1,500 스텝 학습 구간에서 손실 값 차이가 0.0017 수준에 머물렀고, 오차 누적 없이 안정적인 학습이 유지되는 것으로 나타났다. 다만 실제 LLM 사전학습이 수만~수십만 스텝에 이르는 점을 고려하면 추가 검증이 필요하다는 점도 분명하다.

현재 대규모 AI 모델 학습에서는 노드 간 통신이 전체 학습 시간의 최대 절반 이상을 차지하는 병목 요인으로 꼽힌다. 이로 인해 고가의 인피니밴드 네트워크 장비가 필수적으로 요구되며, 인프라 비용 부담이 크게 증가하는 구조다.

야타브는 이번 기술이 상용화될 경우 학습 비용 절감 효과가 발생할 것으로 보고 있다. 내부 분석에서는 수십억 파라미터급 모델 기준으로 수억 원 규모 비용 절감 가능성을 제시했지만, 이는 현재 실험 데이터를 기반으로 한 추정치에 가깝다.

김광일 CTO는 “대규모 인프라 없이도 시도해볼 수 있는 연구라는 점에서 의미를 두고 있다”며 “이론적 정립과 대규모 검증이 뒤따라야 한다”고 말했다.

이성찬 대표 역시 “소규모 팀도 의미 있는 AI 연구에 기여할 수 있다는 가능성을 보여주고 싶었다”고 밝혔다.

이번 연구는 AI 모델 학습 비용 구조를 개선할 수 있는 방향성을 제시했다는 점에서 주목받지만, 실제 산업 적용까지는 성능 안정성 검증과 대규모 환경 테스트가 핵심 과제로 남아 있다.

Copyright ⓒ 스타트업엔 무단 전재 및 재배포 금지

본 콘텐츠는 뉴스픽 파트너스에서 공유된 콘텐츠입니다.