단순 연산을 넘어 AI의 판단과 실행을 조율하는 ‘지휘 능력’까지 통합한 구조로, AI 인프라 주도권 경쟁에서 한발 앞서겠다는 전략으로 풀이된다.

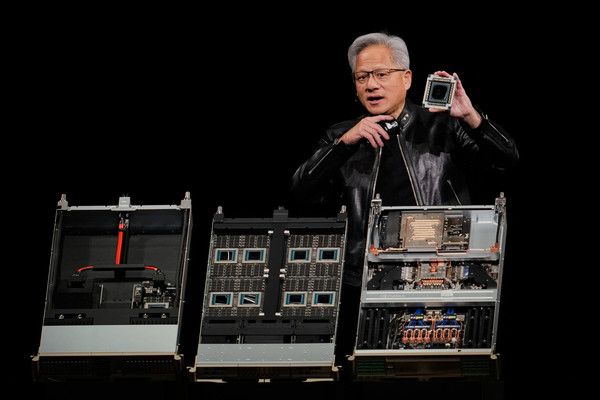

16일(현지시간) 젠슨 황 엔비디아 최고경영자(CEO)는 미국 캘리포니아주 새너제이 SAP센터에서 열린 엔비디아 연례 개발자 회의 ‘GTC 2026’에서 차세대 AI 슈퍼컴퓨터 ‘베라 루빈’을 공개하며 “추론의 변곡점이 도래했다”고 밝혔다.

황 CEO는 AI 에이전트 확산으로 연산 방식의 중심이 학습에서 추론으로 이동하고 있다고 강조했다. 그는 “AI 에이전트 시대에는 단순히 계산을 빠르게 하는 것을 넘어, 수많은 작업을 동시에 조율하고 실행하는 능력이 중요해진다”고 설명했다.

회사 측은 이를 위해 그래픽처리장치(GPU) 중심 구조에 새로운 역할 분담 체계를 도입했다. 대규모 데이터 연산은 GPU가 맡고, 초고속 응답 처리는 추론 전용 칩인 ‘그록3 언어처리장치’(LPU)가 담당하며 전체 시스템의 흐름과 권한을 조율하는 역할은 CPU가 수행하는 구조다.

특히 베라 루빈에는 LPU 256개를 하나로 묶은 ‘LPX 랙’이 통합됐다.

이날 황 CEO는 이 구조를 통해 파라미터가 조 단위에 이르는 초대형 AI 모델의 추론 처리량을 최대 35배 끌어올리고, 지연 시간도 크게 줄일 수 있다고 밝혔다.

이 과정에서 삼성전자 파운드리 사업부가 그록3 LPU 생산을 맡고 있다는 점도 공개됐다.

이를 두고 황 CEO는 기조연설에서 “삼성에 감사한다”고 언급하며 협력 관계를 강조했다.

엔비디아는 동시에 자체 CPU ‘베라’도 함께 선보였다. 베라는 기존 x86 기반 CPU 대비 성능은 1.5배, 에너지 효율은 2배 수준으로 향상됐으며, AI 실행을 위해 설계된 ‘올림퍼스(Olympus) 코어’를 탑재해 메모리 대역폭을 기존 대비 3배 확대했다.

이처럼 GPU·LPU·CPU를 결합한 구조는 AI 에이전트 운용에 필요한 핵심 인프라로 제시된다. GPU가 데이터를 처리하고, LPU가 빠르게 답을 생성하며, CPU가 전체 작업을 조율하는 방식이다.

황 CEO는 AI 에이전트 확산으로 추론 수요가 급격히 증가하고 있다고 강조했다. 그는 “AI 에이전트 등장 이후 필요한 추론량은 초기 챗GPT 대비 1만배 증가했고, 사용량까지 고려하면 연산 수요는 100만배 수준으로 확대됐다”고 설명했다.

Copyright ⓒ 투데이코리아 무단 전재 및 재배포 금지

본 콘텐츠는 뉴스픽 파트너스에서 공유된 콘텐츠입니다.