엔비디아가 차세대 AI 데이터센터 플랫폼 ‘베라 루빈(Vera Rubin)’을 공개하면서, 인공지능 인프라 경쟁이 게임 산업에도 영향을 미칠 가능성이 제기되고 있다. 이번 발표는 단순한 GPU 성능 향상이 아니라, AI 모델 학습과 추론을 위한 데이터센터 구조 자체를 재설계한 플랫폼이라는 점에서 주목된다.

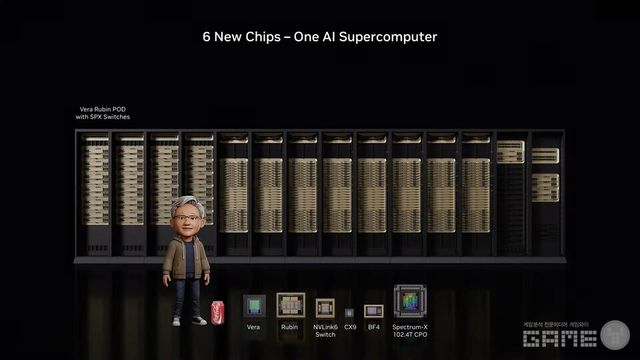

'베라 루빈' 플랫폼의 핵심은 랙 단위 AI 슈퍼컴퓨터 구조다. 대표 구성인 ‘DGX 베라 루빈 NVL72’ 시스템은 하나의 랙 안에 루빈(Rubin) GPU 72개와 베라(Vera) CPU 36개를 통합한 형태로 설계됐다. GPU 간 연결에는 차세대 인터커넥트 기술인 NVLink 6가 사용되며, GPU당 최대 약 3.6TB/s 수준의 대역폭을 제공한다. 루빈 GPU는 차세대 고대역폭 메모리인 HBM4를 기반으로 설계됐다.

베라 CPU는 88개의 맞춤형 Arm 기반 ‘올림푸스(Olympus)’ 코어를 탑재한 데이터센터용 프로세서로, 최대 약 1.2TB/s 수준의 메모리 대역폭을 지원한다. 엔비디아는 이 CPU가 대규모 AI 시스템에서 스케줄링, 데이터 관리, 추론 워크로드 조정 등 다양한 작업을 처리하도록 설계됐다고 설명했다.

NVL72 시스템 전체 기준으로는 NVFP4 연산 기준 약 3,600페타플롭스(PFLOPS)의 추론 성능과 약 2,520PFLOPS 수준의 학습 성능이 제시됐다. 엔비디아는 이 구조를 통해 이전 세대인 블랙웰(Blackwell) 기반 시스템과 비교할 때 대규모 MoE(Mixture-of-Experts) 모델 학습에 필요한 GPU 수를 최대 4배 줄일 수 있으며, 토큰당 추론 비용 역시 최대 10분의 1 수준까지 낮출 수 있다고 밝혔다.

단순한 칩 제품군을 넘어 AI 데이터센터 전체 구조를 함께 제시했다. NVL72 시스템에는 ConnectX-9 SuperNIC, BlueField-4 DPU, NVLink 6 스위치, Spectrum-X 이더넷 네트워크 등이 통합된다. 엔비디아는 이러한 구조를 ‘AI 팩토리(AI Factory)’라는 개념으로 설명하며, 대규모 데이터센터를 AI 모델 학습과 추론을 위한 일종의 생산 시설처럼 운영 예정이다.

하드웨어와 함께 AI 모델 생태계 확장도 동시에 진행되고 있다. 엔비디아는 에이전트 기반 AI 시스템을 겨냥한 ‘네모트론(Nemotron)’ 모델 계열을 비롯해, 물리 환경 시뮬레이션을 위한 월드 모델 ‘코스모스(Cosmos)’, 휴머노이드 로봇용 비전-언어-액션 모델 ‘아이작 GR00T’ 등 다양한 AI 모델을 공개했다. 네모트론 3 계열은 MoE를 포함한 하이브리드 아키텍처로, 긴 컨텍스트 처리와 복잡한 워크플로 자동화를 겨냥해 설계됐다.

이 같은 인프라 변화는 게임 산업에도 적지 않은 영향을 미칠 것으로 예상된다. 특히 대형 게임사를 중심으로 ‘AI 팩토리’ 형태의 인프라 투자를 검토하는 움직임이 늘어날 가능성이 있다. 대규모 게임 서비스에서는 플레이어 행동 데이터 분석, 게임 경제 시뮬레이션, 개인화 콘텐츠 추천, NPC 행동 모델링 등 다양한 영역에서 AI 모델 활용이 확대되고 있기 때문이다.

게임 운영 방식에도 변화가 예상된다. AI 추론 비용이 낮아질 경우 플레이어와 자연스럽게 대화하는 NPC나 실시간 게임 밸런스 분석, 이벤트 운영 자동화 같은 기능을 보다 현실적인 비용 구조에서 구현할 수 있다. 이러한 기능은 그동안 연구 단계에서는 가능성이 제시되어 왔지만, 실제 서비스에서는 서버 비용과 인프라 부담 때문에 제한적으로 활용되는 경우가 많았다.

또 다른 변화는 인프라 격차에 따른 경쟁력 차이다. 대형 퍼블리셔와 플랫폼 기업은 자체 데이터센터 구축이나 대형 클라우드 인프라를 활용해 AI 기능을 빠르게 도입할 수 있는 반면, 중소 게임사는 고성능 AI 인프라 확보가 쉽지 않을 수 있다. 이 경우 생성형 콘텐츠나 에이전트 기반 사용자 경험 등 차세대 게임 기능에서 격차가 벌어질 가능성도 있다.

국내 게임사 입장에서는 전략 선택이 중요한 시점이 될 것으로 보인다. 하나는 글로벌 클라우드 사업자가 제공하는 AI 인프라를 활용하는 방식이고, 다른 하나는 국내 데이터센터 사업자와 협력해 자체 AI 인프라를 구축하는 방식이다. 전자는 초기 투자 부담이 적지만 장기적으로 클라우드 비용에 영향을 받을 수 있고, 후자는 초기 자본 투입이 크지만 데이터와 AI 모델을 보다 직접적으로 통제할 수 있다는 장점이 있다.

관련 업계에서는 '베라 루빈' 플랫폼이 단순한 GPU 세대 교체가 아닌, AI 데이터센터 구조 자체를 재편하려는 시도라는 평가가 나온다. AI 모델과 인프라, 데이터센터 설계까지 하나의 생태계로 묶는 전략이 현실화될 경우, 게임 산업에서도 AI 인프라 경쟁이 새로운 변수로 떠오를 가능성이 있다는 분석이다.

Copyright ⓒ 게임와이 무단 전재 및 재배포 금지

본 콘텐츠는 뉴스픽 파트너스에서 공유된 콘텐츠입니다.