AI 경량화·최적화 기술 기업 노타가 대형언어모델(LLM)의 메모리 사용량을 크게 줄이면서도 성능을 유지하는 양자화 기술을 개발했다.

노타는 업스테이지의 대형언어모델 솔라(Solar Open 100B)에 자사 경량화·최적화 기술을 적용해 모델 메모리 사용량을 약 72% 줄이는 데 성공했다고 밝혔다. 이번 연구는 과학기술정보통신부가 추진 중인 ‘독자 AI 파운데이션 모델 프로젝트’의 일환으로 진행됐다.

최근 대형언어모델에서는 여러 전문가 모델을 조합하는 구조인 Mixture of Experts(MoE)가 널리 활용되고 있다. 다만 기존 양자화 기술은 모델 전체를 동일하게 압축하는 방식이 많아 MoE 구조에서 성능 저하가 발생하는 한계가 지적돼 왔다.

노타는 이러한 문제를 해결하기 위해 ‘노타 MoE 양자화(Nota MoE Quantization)’ 알고리즘을 개발했다. 이 기술은 전문가 모델별 특성을 고려해 필요한 연산에는 높은 정밀도를 유지하고, 상대적으로 중요도가 낮은 부분만 압축하는 방식으로 설계됐다. 이를 통해 양자화 과정에서 발생하는 왜곡을 줄이고 모델 성능을 유지하는 것이 특징이다.

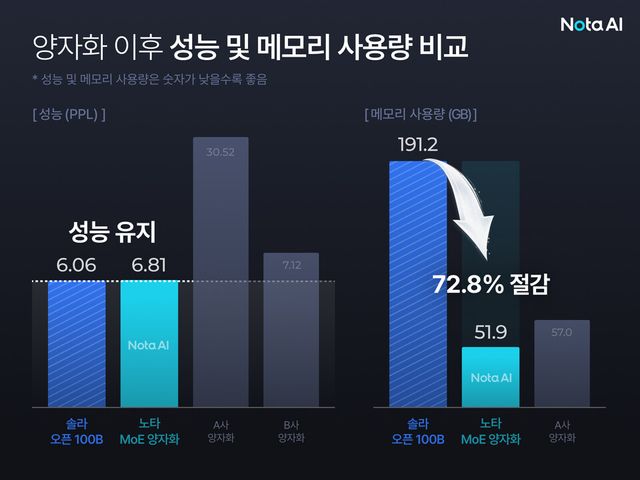

기술 적용 결과, 약 1000억 개 파라미터를 가진 솔라 100B 모델의 메모리 사용량은 기존 191.2GB에서 51.9GB 수준으로 줄었다. 이는 약 72.8%의 메모리 절감 효과다.

모델 성능 지표인 PPL(Perplexity) 역시 6.81을 기록해 원본 모델(6.06)과 유사한 수준을 유지했다. 일부 범용 양자화 방식에서 성능이 크게 떨어지는 것과 비교하면 성능 손실을 상대적으로 최소화했다는 설명이다.

노타는 해당 기술에 대해 특허를 출원했으며, 향후 다양한 LLM 환경에서 활용 가능성을 검토하고 있다.

대형언어모델은 높은 GPU 메모리를 요구하기 때문에 로봇이나 차량 등 물리적 디바이스에 직접 탑재하기 어려운 경우가 많다. 이번 기술은 대규모 모델의 메모리 요구량을 줄여 제한된 하드웨어 환경에서도 LLM을 활용할 수 있는 가능성을 제시했다는 평가다.

업계에서는 이러한 경량화 기술이 확산될 경우 기업들이 동일한 인프라에서 더 많은 AI 서비스를 운영하거나, 온디바이스 AI 활용 범위를 넓히는 데 기여할 수 있을 것으로 보고 있다.

Copyright ⓒ 스타트업엔 무단 전재 및 재배포 금지

본 콘텐츠는 뉴스픽 파트너스에서 공유된 콘텐츠입니다.