192GB 한계 넘어 모듈당 256GB로 확대… 8채널 CPU 기준 LPDRAM 2TB 구성, 긴 컨텍스트 추론 효율 노린다

마이크론이 SOCAMM2 메모리 모듈의 용량을 256GB까지 끌어올리고 고객사에 샘플 출하를 시작했다. 기존 192GB급에서 한 단계 더 올라간 구성으로, 에이전트형(Agentic) AI처럼 긴 컨텍스트와 낮은 지연이 동시에 요구되는 워크로드에서 메모리 병목을 줄이겠다는 방향이 핵심이다. SOCAMM2는 서버 메모리와는 다른 형태로 LPDRAM 기반의 고용량·저전력 구성을 노린다.

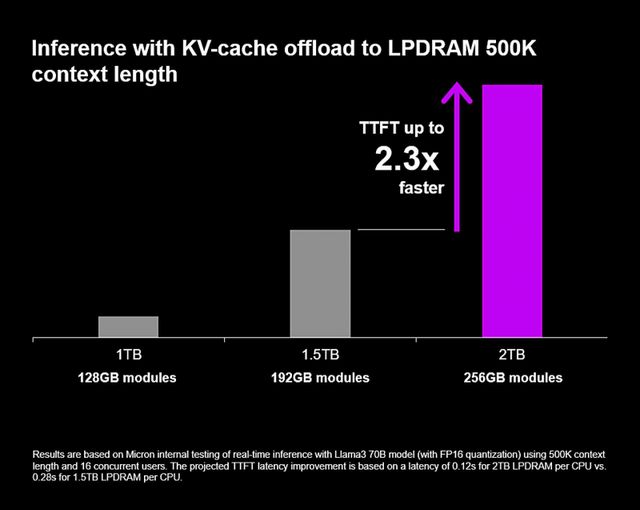

이번 세대에서 마이크론은 단일 LPDRAM 모놀리식 다이 용량을 32GB까지 올렸다고 밝혔다. 256GB 모듈을 기준으로 하면, 8채널 CPU 구성에서 LPDRAM을 최대 2TB까지 붙일 수 있다는 계산이 나온다. 긴 컨텍스트 윈도우를 처리할 때 메모리 한계가 먼저 드러나는 환경을 겨냥한 접근이다. 특히 KV 캐시(KV-cache)를 LPDRAM으로 오프로딩하는 방식으로 지연을 줄이고, CPU 중심 구성에서도 에이전트형 워크로드를 더 안정적으로 처리할 수 있다.

Micron’s achievements in delivering massive memory capacity and bandwidth using less power than traditional server memory with 256GB SOCAMM2 is enabling the next generation of AI CPUs.

256GB SOCAMM2로 전통적인 서버 메모리보다 더 낮은 전력으로 대용량 용량과 대역폭을 제공하는 성과가 차세대 AI CPU를 가능하게 하고 있다.

Ian Finder, Head of Product, Data Center CPUs at NVIDIA

마이크론은 긴 컨텍스트 추론에서 TTFT가 2.3배 개선됐다고도 언급한다. 에이전트형 워크로드는 응답 지연이 곧 사용자 경험으로 직결되고, 모델이 긴 문맥을 끌고 갈수록 KV 캐시가 차지하는 메모리 압박도 커진다. SOCAMM2는 이 구간에서 ‘메모리로 인해 느려지는’ 병목을 줄이는 쪽으로 설계된 셈이다.

SOCAMM2는 엔비디아와의 협업을 통해 추진된 규격으로, 차세대 AI 인프라 플랫폼에서 채택이 확대될 가능성이 있다. 다만 이런 고용량 AI 메모리 솔루션이 본격적으로 물량을 먹기 시작하면, 전체 DRAM 공급 내에서 다른 제품군의 배분에도 영향을 줄 수 있다. 범용 DRAM이나 그래픽용 메모리 같은 영역이 공급 압박을 받는 시나리오가 같이 거론되는 이유다.

256GB SOCAMM2는 이미 고객사에 샘플이 출하됐고, GTC 2026에서 전시될 예정이다. 에이전트형 AI 확산으로 ‘연산’만큼 ‘메모리’가 병목이 되는 구간이 늘어나는 상황에서, SOCAMM2는 용량·전력·지연을 동시에 건드리는 카드로 자리 잡을 가능성이 크다.

본 콘텐츠는 뉴스픽 파트너스에서 공유된 콘텐츠입니다.