구글 ATLAS, AI 기억의 한계를 넘다: '최적 문맥 암기' 혁명

초장문맥 시대의 서막: ATLAS와 DEEP TRANSFORMERS (arXiv:2505.23735)

현대 자연어 처리 분야에서 트랜스포머 아키텍처는 압도적인 성능으로 핵심 기술로 자리 잡았습니다. 그러나 입력 시퀀스가 길어질수록 연산량과 메모리 사용량이 제곱(O(N^2))으로 증가하는 고질적인 확장성 문제로 인해, 수백만 토큰 이상의 초장문맥을 효과적으로 다루는 데는 뚜렷한 한계에 직면해왔습니다. 이러한 중대한 기술적 난제를 해결하기 위해, 최근 구글 리서치 소속 Ali Behrouz 제1저자 연구팀은 'ATLAS'라는 혁신적인 장기 메모리 모듈과 이를 기반으로 한 'DEEP TRANSFORMERS' 아키텍처를 발표하며 인공지능 연구계에 새로운 지평을 열었습니다. (논문 원본 게시일: 2025년 5월 29일, arXiv:2505.23735)

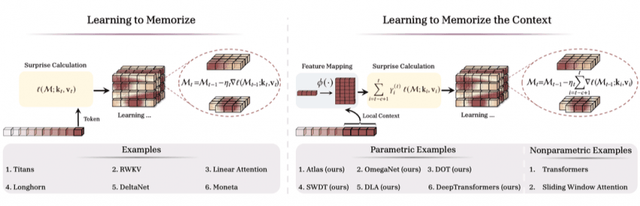

ATLAS 설계의 핵심 철학은 '테스트 시간에 최적으로 문맥을 기억하도록 학습'하는 것입니다. 이는 기존 장기 메모리 모델들이 주로 가장 최근 입력에만 의존해 메모리를 업데이트하는 온라인 방식에서 벗어나, 현재 처리 중인 토큰과 관련된 과거 토큰들의 문맥을 종합적으로 고려하여 메모리를 동적으로 최적화합니다. 이를 통해 마치 인간이 복잡한 정보를 이해하고 기억하듯, 문맥 전체의 의미론적 맥락을 유기적으로 파악하고 깊이 있게 저장하도록 설계되었습니다. 이는 단순히 개별 토큰의 피상적 암기에 치중했던 기존 방식과는 질적으로 차별화되는, 그야말로 패러다임 전환적 접근법이라 할 수 있습니다.

Copyright ⓒ 시보드 무단 전재 및 재배포 금지

본 콘텐츠는 뉴스픽 파트너스에서 공유된 콘텐츠입니다.