특히, 기존에 사용되던 그래픽 처리장치(GPU)보다 크기가 작고 전력 소모가 월등하게 낮음에도 GPT와 같은 거대언어모델(LLM)을 처리할 수 있어 관련업계의 이목이 쏠리고 있다.

지난 6일 과학기술정보통신부는 유회준 한국과학기술원(KAIST) 프로세싱인메모리(PIM) 반도체연구센터 및 AI 반도체 대학원 교수 연구팀이 ‘상보형-트랜스포머’를 삼성전자 28나노 공정을 통해 개발했다고 밝혔다.

구체적으로 해당 기술은 심층 인공 신경망(DNN)과 스파이킹 뉴럴 네트워크(SNN)을 혼합 사용해 전력 소모를 최소화하는 방식으로 마치 사람의 뇌가 생각할 것이 많을 때와 생각할 것이 적을 때 에너지를 다르게 사용하는 것과 비슷하게 작동한다.

해당 기술은 이번 연구의 제1저자인 김상엽 박사가 지난해 2월 국제고체회로설계학회(ISSCC)에서 발표한 것으로 이번 연구에서는 해당 기술을 거대 언어 모델에 적용함으로써 초저전력·고성능의 온디바이스 AI가 가능하다는 것을 실제로 입증한 것이다.

유 교수 연구팀이 개발한 AI 반도체는 400밀리와트(mw) 가량의 초저전력으로 구동되면서도 0.4초만에 거대언어모델(LLM)을 처리할 수 있는 것으로 알려졌다.

특히 생성형 AI를 구동하는데 핵심 요소로 꼽히는 그래픽 처리장치(GPU)와 비교했을 때 크기와 소모전력 대비 성능효율면에서 압도적인 차이를 나타내 관련 업계의 이목이 쏠리고 있다.

해당 AI 반도체의 소모전력은 엔비디아의 GPU와 비교했을 때 최대 625분의 1 수준으로 낮으면서도 칩의 크기는 1cm가 채 안되는 41분의 1 수준(4.5mm x 4.5mm)으로 이를 통해 스마트폰 등의 기기에 탑재되어 클라우드를 거치지 않고도 생성형 AI를 구동할 수 있을 전망이다.

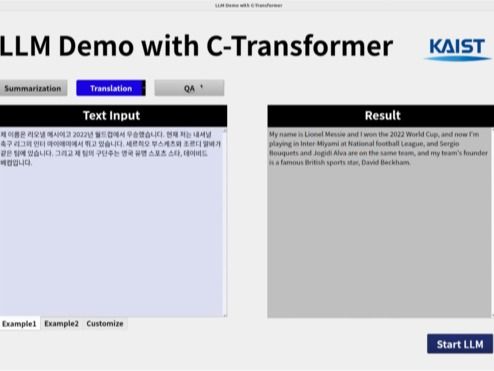

실제로 지난 6일 개발에 참여한 김상엽 KAIST 박사는 인터넷이 연결되지 않은 상태에서 해당 칩을 연결해 GPT-2로 문장 요약 및 번역 등을 시연한 결과 일반 노트북보다 최대 9배 가량 빠른 속도를 나타냈다. 또한 갤럭시 S24에 연결해서도 GPT-2를 쉽게 구동시켰다.

유회준 KAIST 전기및전자공학부 교수는 “이번 연구는 기존 인공지능반도체가 가지고 있던 전력 소모 문제를 해소했을 뿐만 아니라, GPT-2와 같은 실제 거대언어모델 응용을 성공적으로 구동했다는데 큰 의의가 있다”며 “뉴로모픽 컴퓨팅은 인공지능시대에 필수적인 초저전력·고성능 온디바이스AI의 핵심기술인만큼 앞으로도 관련 연구를 지속할 것”이라고 전했다.

Copyright ⓒ 투데이코리아 무단 전재 및 재배포 금지

본 콘텐츠는 뉴스픽 파트너스에서 공유된 콘텐츠입니다.